Ein Web Unblocker (oder Web Unlocker) ist ein Online-Tool, mit dem Sie CAPTCHAs, Anti-Bot-Systeme und Sperren umgehen können, um auf jede beliebige Website zuzugreifen. Ein Web-Unblocker ist eine weitaus fortschrittlichere Version eines Web-Proxys. Anstatt URL-Anfragen nur über eine andere IP-Adresse umzuleiten, umgehen Web Unlocker auch Anti-Bot-Systeme, um nicht nur auf Webinhalte zuzugreifen, sondern auch HTML- und JSON-Daten zu scrapen.

Benutzer verwenden in der Regel Web Unblocker für die Automatisierung von Data Scraping. In diesem Blog erfahren Sie mehr über Web Unblocker, wie sie sich von Proxys unterscheiden, welche Anwendungsfälle sie bedienen und wie Sie eine Web Scraping-Automatisierung mit einer zuverlässigen Web Unblocker API einrichten. Lassen Sie uns eintauchen!

Vergleich: Web Unblocker vs. Web Proxy

Eine reguläre Web-Proxy-Website hilft Ihnen beim Zugriff auf eingeschränkte Inhalte, indem sie Ihren Datenverkehr über eine andere IP umleitet – das war’s. Web-Proxys sind in der Regel auch langsamer, weil dieselbe IP und derselbe Server von Hunderten oder Tausenden von Nutzern genutzt werden, die gleichzeitig mehrere Anfragen senden. Premium-Versionen von Web-Proxys sind schneller, können aber dennoch von mehreren Premium-Nutzern gemeinsam genutzt werden.

Ein Web Unblocker tut mehr als nur IP-Adressen zu wechseln. Er versucht, eine echte, menschenähnliche Interaktion mit der Website zu imitieren. Er schaltet nicht nur gesperrte Inhalte frei oder leitet den Datenverkehr um, sondern löst auch CAPTCHAs, umgeht Anti-Bot-Systeme und schützt Ihr Konto davor, gesperrt zu werden, indem er sich so verhält, als würde ein echter Mensch auf der Website surfen.

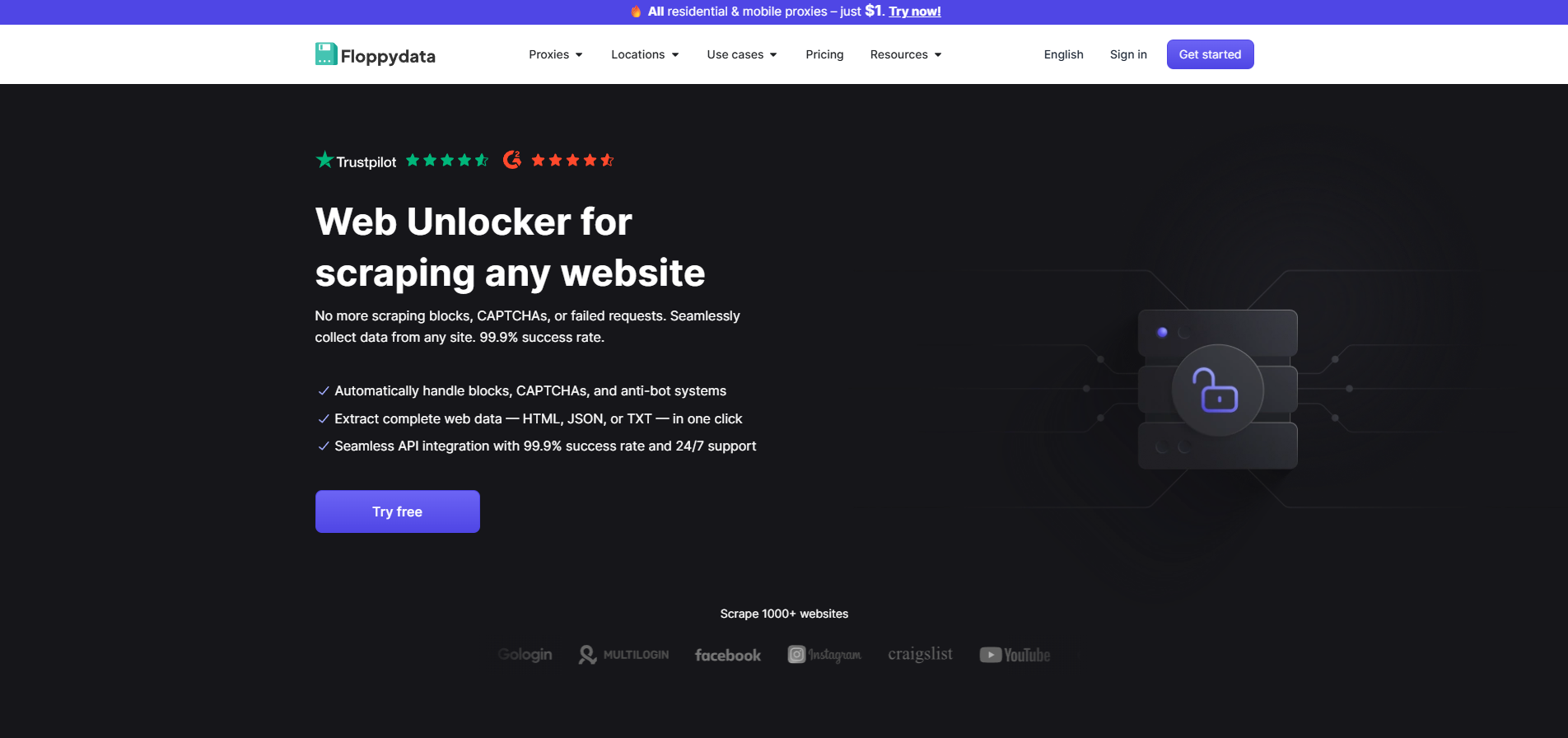

Wenn Sie einen fortschrittlichen Webblocker wie den Web Unlocker von Floppydata verwenden, können Sie auch nützliche Daten von jeder beliebigen Website wie Facebook, Craigslist, Instagram, Ebay und mehr abgreifen. Diese gescrapten Daten werden dann bereinigt und für das Training von KI-Modellen, die Entwicklung von Tools für bestimmte Plattformen und andere nützliche Anwendungsfälle verwendet.

Web Unblocker Anwendungsfälle

Die Verwendung eines Web Unblockers ist nicht illegal. Die Legalität hängt davon ab, was Sie mit den Web Unblockern vorhaben. Wenn Sie Daten für ein von Ihnen entwickeltes Tool eines Drittanbieters oder für KI-Training auslesen, ist das kein Problem. Hier sind einige gängige Anwendungsfälle für Web Unblocker.

1. Automatisierung von Web Scraping in großem Maßstab

Der größte Anwendungsfall von Web Unlockers ist die Automatisierung von Web Scraping. Sie scrapen nicht nur eine URL, sondern erstellen eine komplette Automatisierung, die konfigurierte URLs oder Domains selbstständig durchsucht, Daten von allen Seiten scrabbt und filtert, um Ihnen die benötigten Daten zu liefern.

Wenn Sie die Daten einer Website scrapen, erhalten Sie einen HTML-Code der Webseite. Dieser enthält den gesamten Inhalt der Seite und wie sie aufgebaut ist. Sie können dann nützliche Informationen aus bestimmten Feldern extrahieren. Viele Menschen nutzen Web Scraping, um ihre Tools zur Überwachung von Produktpreisen, SERP-Tracking für SEO, Immobilienangebote, Jobbörsen und Marktforschung zu betreiben.

2. Eingeschränkte Inhalte freischalten

Inhalte sind nicht immer geobeschränkt. Manchmal verbietet das Netzwerk, in dem Sie sich befinden (Büro, Schulnetzwerk), bestimmte Websites und Endpunkte. Sie können einen Web Unblocker verwenden, um unbemerkt auf diese Websites zuzugreifen. Wenn Sie einen guten Webblocker wie Floppydata verwenden, erhalten Sie dedizierte IP-Adressen und 99,9 % Zuverlässigkeit.

3. QA-Tests und Überwachung

Wenn Sie das Anti-Bot-System Ihrer Website testen möchten oder testen wollen, ob es in verschiedenen Regionen funktioniert und wie hoch die Latenz ist, sind Web Unblocker ein großartiges Werkzeug. In diesem Fall greifen Sie zwar nicht direkt auf eine blockierte Website zu, aber Sie können die Automatisierungsfunktion nutzen, um automatisierte Tests durchzuführen. Sie können sogar Ihre eigenen IP-Adressen angeben, indem Sie Proxys aus bestimmten Ländern oder sogar Städten auswählen.

4. Datenerfassung für KI und Analytik

Modelle für maschinelles Lernen benötigen Unmengen von Daten für das Training. Da Unternehmen aktuelle Daten aus dem Internet bevorzugen, verwenden sie Web Unblocker und deren API-Unterstützung, um Websites zu scrapen, ihre Seiteninhalte zu speichern, nützliche Daten aus dieser HTML- oder JSON-Datei zu extrahieren und sie für bessere Ergebnisse in ihr Modell einzuspeisen.

Warum blockieren Websites das Data Scraping?

Wenn Data Scraping legal ist, warum setzen Unternehmen dann so starke Maßnahmen gegen Data Scraper ein? Wenn Sie versuchen, mit einem Python-Skript Daten von einer Webseite zu scrapen, kann Ihre IP-Adresse blockiert werden. Sie können dann von Ihrem Gerät aus nicht mehr auf die Website zugreifen. Es gibt mehrere Gründe, warum Unternehmen dies tun, darunter die Überlastung der Server und der Schutz der Privatsphäre der Benutzer.

Unternehmen mögen keine Data Scraper und Web Unblocker, weil sie die Server unnötig belasten. Eine typische Data Scraper-Automatisierung sendet Tausende von Seitenanfragen gleichzeitig, um riesige Datenmengen abzugreifen. Die Unternehmen müssen für die Belastung ihrer Server durch Data Scraper bezahlen.

Der Schutz des geistigen Eigentums ist ein weiterer Grund. Wenn eine Website Zeit, Ressourcen und Mühe aufwendet, um authentische Inhalte ins Netz zu stellen, möchte sie nicht, dass Data Scraper sie einfach abgreifen und unerlaubt verwenden. In ähnlicher Weise schützen die Plattformen sozialer Medien die Privatsphäre ihrer Kunden. Ein Scraper kann sich Zugang zu öffentlichen Daten von Facebook, Instagram usw. verschaffen, die zur Erstellung von Social Media Tools verwendet werden.

Wie schützt Web Scraping mit einem Web Unblocker vor dem Verbot?

Wenn Sie ein Anfänger sind, sollten Sie niemals versuchen, auch nur ein Testskript auf Ihrem Gerät ohne einen zuverlässigen Proxy auszuführen. Eine seriöse Plattform wie Facebook kann Ihre Netzwerk-IP und Ihren Geräte-Fingerabdruck für immer speichern. Sie werden nicht mehr in der Lage sein, mit Ihrem Gerät auf die Plattform zuzugreifen. Web Unblocker sind der sicherste Weg, um Testskripte auszuführen.

Wie Websites Web Scraping-Automatisierungen erkennen und verbieten

Eine Website verfolgt im Allgemeinen Folgendes:

- Anzahl der Anfragen pro Minute

- IP-Adresse, über die Anfragen gestellt werden

- Browser-Fingerabdruck des Benutzers (Schriftarten, WebGL, Betriebssystem, Zeitzone usw.)

Wenn die Website eine Spam-Aktivität feststellt, blockiert sie die IP und den Fingerabdruck des Browsers. Web Unblocker helfen Ihnen, dies zu vermeiden.

Wie der Floppydata Web Unlocker sicheres Web Scraping ermöglicht

Floppydata Web Unlocker verwendet einen eigenen Pool rotierender IP-Adressen und Fingerabdrücke, um Ihnen beim Scrapen von Daten zu helfen. Anstatt Ihre Netzwerk-IP und Ihren Geräte-Fingerabdruck zu verwenden, nutzt Floppydata sichere und saubere Proxys aus über 195 Ländern sowie eine starke Browser-Fingerabdruck-Technologie. Es sendet Anfragen von verschiedenen IPs und Fingerabdrücken. Die Plattformen behandeln jede Anfrage als ein einzigartiges Gerät. Dies hilft Ihnen, Sperren zu vermeiden.

Darüber hinaus verfolgen fortschrittliche Erkennungssysteme auch das Surfverhalten, z. B. wie CAPTCHAs gelöst werden und ob die Mausklicks zufällig oder roboterhaft sind. Floppydata Web Unlocker hilft hier, indem er ein menschenähnliches Surfverhalten nachahmt, um Daten zu erhalten. Wenn eine Floppydata-IP blockiert wird, verwendet er automatisch seine Wiederholungslogik und sendet die gleiche Anfrage von einem anderen Proxy aus erneut.

Leitfaden: Wie man Floppydata Web Unlocker für Web Scraping Automation verwendet

Wenn Sie ein Experte für Web Scraper sind, ist Floppydata Web Unlocker die perfekte Wahl. Er hat zwei Modi.

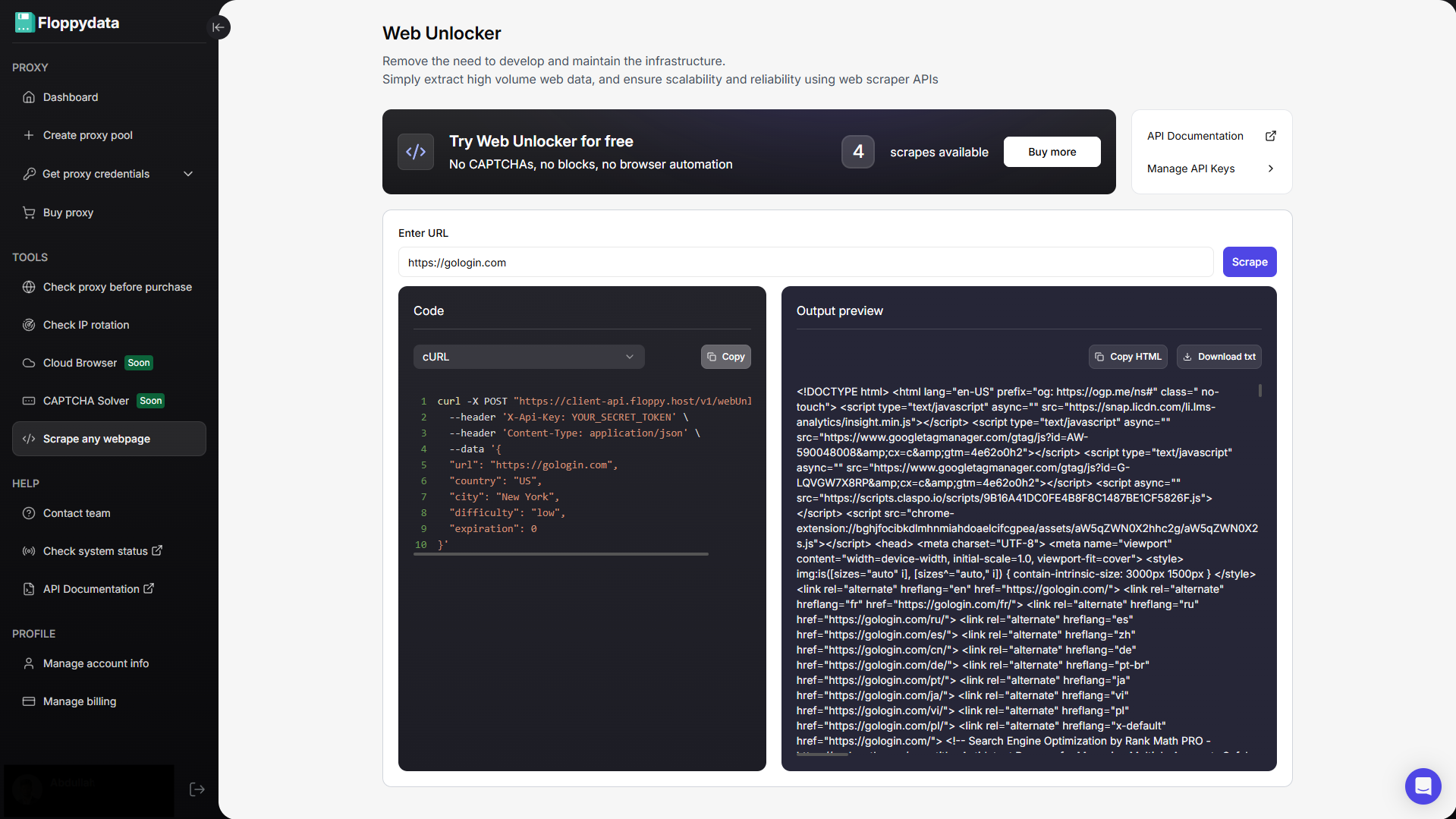

- In-App Scraper für sofortiges Scrapen einer beliebigen URL

- API-Modus zur Ausführung von Web-Scraping-Automatisierungen in großen Mengen mit Wiederholungslogik

Wenn Sie den Inhalt einer einzelnen Webseite abrufen möchten, können Sie den In-App-Unblocker von Floppydata verwenden. Diese Methode wird im Allgemeinen verwendet, um den HTML-Inhalt einer Website abzurufen und zu analysieren, wie die Informationen angezeigt werden.

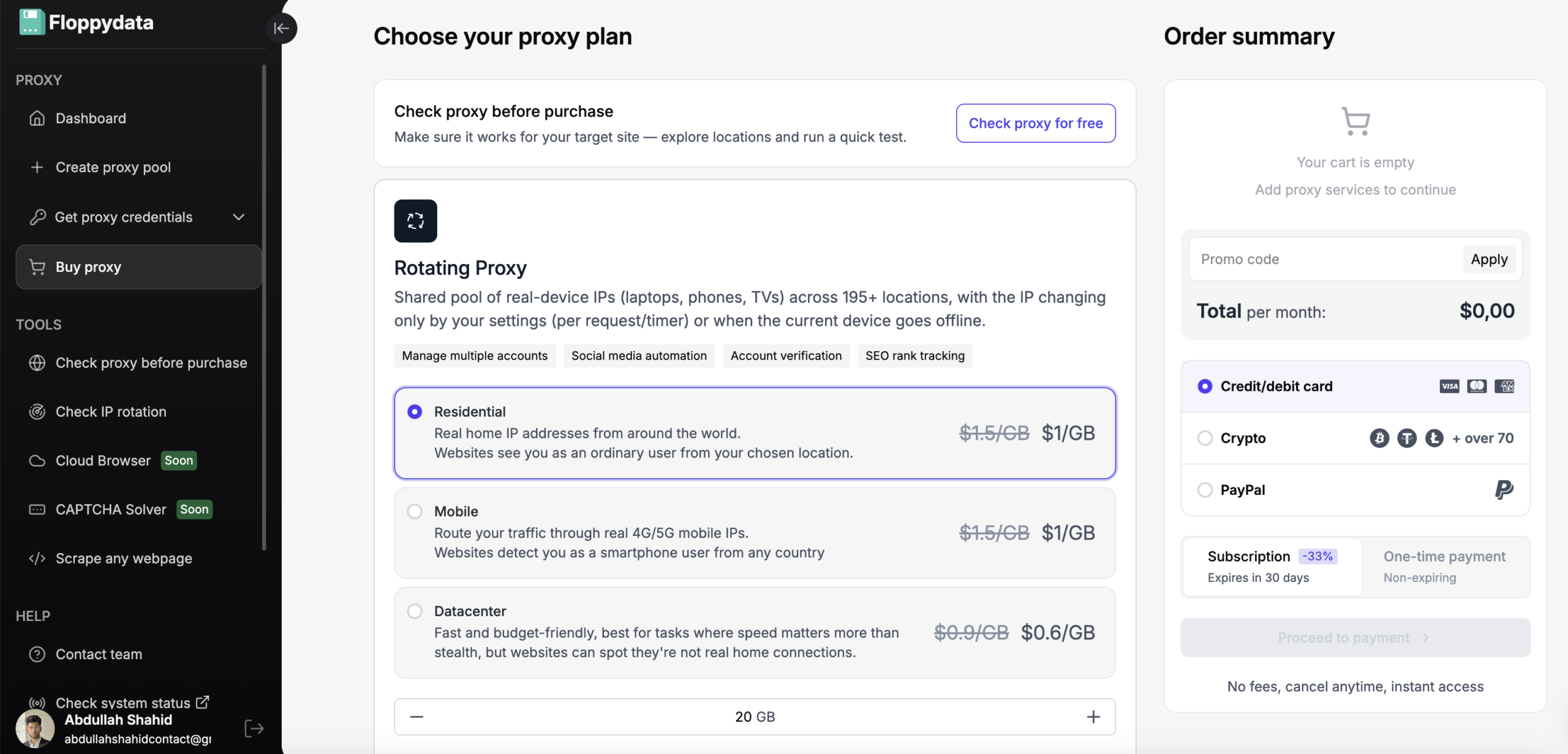

Schritt #1: Erstellen Sie ein Floppydata-Konto

Melden Sie sich bei Floppydata an und öffnen Sie das Dashboard. Hier können Sie Ihre Proxys und Tools wie den Web Unlocker verwalten.

Schritt #2: Erstellen Sie einen Proxy-Pool

Sie können Proxys aus mehr als 195 Ländern kaufen und einen Proxy-Pool zur Nutzung erstellen. Sie können entweder statische IPs kaufen oder eine Bandbreite für rotierende IPs erhalten, die bei jeder Anfrage automatisch ersetzt werden, um nicht entdeckt zu werden.

Schritt #3: Analysieren Sie die Ziel-URL

Fügen Sie Ihre URL in das angezeigte Feld ein und klicken Sie auf Analysieren. Sie erhalten den HTML-Inhalt dieser Seite zusammen mit einem Codeschnipsel, den Sie zu Ihrer Browser-Automatisierung hinzufügen können. Wenn Sie eine Automatisierung zum Abrufen von Produktpreisen von einer Website erstellen, können Sie den Website Unlocker verwenden, um zu analysieren, welches Tag die Website anzeigt. Ich werde dann mein Automatisierungsskript so schreiben, dass es speziell die folgenden Tags extrahiert und sie in meiner Excel/csv-Datei speichert.

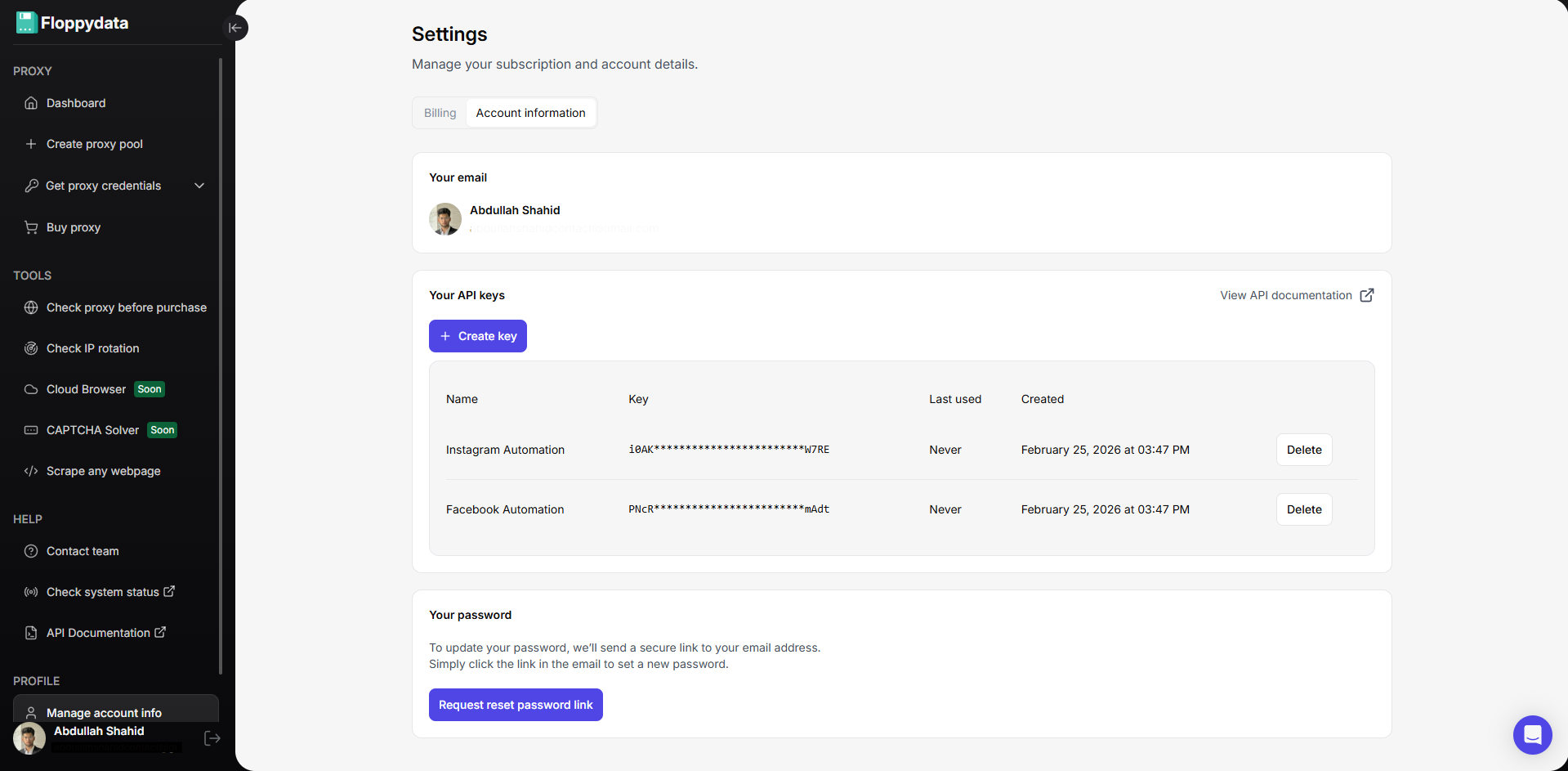

Schritt #4: API-Schlüssel für die Automatisierung erstellen

Sie können über Ihre Kontoeinstellungen API-Schlüssel erstellen. Diese API-Schlüssel werden in Ihrem Skript zur Browser-Automatisierung verwendet, um Proxys zu drehen, Websites freizuschalten und Daten zu scrapen. Floppydata Web Unlocker schöpft Daten ab und sendet sie über diese API an Ihr Skript.

Schritt #5: Web Scraping Automation schreiben und ausführen

Jetzt, da Sie den API-Schlüssel und die Proxys haben, können Sie ein Web-Scraping-Skript in Python, Javascript, C# oder GO erstellen. Fügen Sie Ihren API-Schlüssel zusammen mit den URLs in das Code-Snippet ein, das auf der Seite zum Freischalten des Webs angezeigt wird. Sie können Ihrem Skript auch weitere Funktionen hinzufügen, z. B. die Suche nach bestimmten Tags in den von der API gescrapten Daten, und diese in einer csv- oder Excel-Datei auf Ihrem Gerät speichern.

So sieht ein typisches Python-Snippet aus:

httpx.post(

„https://client-api.floppy.host/v1/webUnlocker“,

headers={

„Content-Type“: „application/json“,

„X-Api-Key“: „YOUR_SECRET_TOKEN“

},

json={

„url“: „http://ip-api.com/json“,

„Land“: „US“,

„Stadt“: „New York“,

„Schwierigkeit“: „niedrig“,

„Verfall“: 0

}

)

Fazit

Anstatt mehrere Browser herunterzuladen und Proxys in jedem Profil zu konfigurieren, können Sie alle Ihre Web-Scraping-Automatisierungen mit dem API-Schlüssel von Floppydata durchführen. Sie können diesen API-Schlüssel auch mit einem Antidetektiv-Browser wie Gologin koppeln, der Ihre Web-Scraping-Automatisierung um eine weitere Ebene der Unauffälligkeit und Sicherheit ergänzt, um ein nahtloses Erlebnis zu gewährleisten.

Viel Spaß beim Schaben!

Teilen Sie diesen Artikel:

Inhaltsverzeichnis

Proxies für $1

Erhalten Sie unbegrenzte Möglichkeiten