Запустить автоматизацию веб-скреппинга в 2026 году не так-то просто. Поскольку многие компании, занимающиеся разработкой искусственного интеллекта, пытаются выудить из интернета как можно больше данных для обучения моделей, такие платформы, как Reddit, Meta, X и другие, развертывают системы обнаружения на основе искусственного интеллекта, чтобы не дать веб-скреперам получить доступ к публичным пользовательским данным. Итак, в этом руководстве мы рассмотрим, как масштабировать и автоматизировать веб-скрейпинг в 2026 году.

Почему веб-скраппинг становится все сложнее?

Вот несколько причин, по которым компании активно выявляют и блокируют автоматические средства веб-скреппинга.

- Веб-скреперы создают лишнюю нагрузку на серверы, поскольку отправляют сотни или даже тысячи одновременных автоматических запросов.

- Рекламодатели не любят ботов, потому что реклама показывается боту, соскабливающему данные со страницы, и рекламные расходы пропадают впустую.

- Большинство компаний предпочитают продавать свои данные другим ИИ-компаниям или обучать собственные модели. Поэтому они не хотят, чтобы скреперы бесплатно извлекали данные из их платформы.

Тем не менее, в 2026 году все еще существуют некоторые эффективные методы сбора данных, которые не только безопасны в использовании, но и масштабируемы, легко автоматизируемы и работают для всех веб-сайтов. Поскольку системы защиты от ботов становятся все умнее благодаря искусственному интеллекту, веб-скреперы также идут в ногу со временем, обеспечивая автоматическое решение CAPTCHA, рандомизацию движений мыши и кликов, ротацию IP-адресов, рандомизацию отпечатков пальцев браузера и многое другое.

Как масштабировать веб-скраппинг?

Скрапить пару веб-страниц — не проблема, но как скрапить тысячи веб-страниц в течение нескольких часов или дней? Мы не можем открыть столько вкладок на нашем устройстве из-за ограничения оперативной памяти и скорости обработки, и если наш IP-адрес будет заблокирован в первые несколько минут, нам придется перейти на другое устройство.

Масштабирование веб-скреппинга требует понимания и планирования. Для начала давайте разберемся, какие проблемы возникают при веб-скреппинге.

Проблемы, связанные с веб-скреппингом

Веб-сайты — это уже не просто статичные HTML-страницы. Системы защиты от ботов постоянно отслеживают активность пользователей и качество трафика, чтобы гарантировать, что только реальные пользователи получают доступ к сайтам, а скреперы мгновенно блокируются. Вот с какими проблемами я столкнулся, когда начал заниматься веб-скраппингом:

- Ограничение скорости передачи данных по IP: Платформы отслеживают количество запросов на IP каждую минуту и час. Если IP-адрес пытается превысить лимит, учетная запись приостанавливается или временно отключается за спам.

- Рендеринг на Javascript: Многие веб-сайты теперь загружают содержимое динамически. Когда скрапер пытается получить HTML-контент, он получает недостающие поля, потому что некоторые части страницы не были загружены.

- CAPTCHAs: Мои скрипты для веб-скреппинга с трудом решали CAPTCHA и постоянно блокировали меня. Facebook даже запретил мой IP, и я больше не мог зайти на сайт через тот же IP.

- Обнаружение поведения: Веб-сайты отслеживают ваше поведение: активность прокрутки, движения мыши, случайность нажатий и т. д., чтобы понять, являетесь ли вы ботом или реальным человеком.

- Отслеживание отпечатков пальцев: Платформы сохраняют и отслеживают отпечаток пальца вашего браузера, чтобы определить, какие устройства используют эту учетную запись. В случае обнаружения нарушений условий предоставления услуг они могут запретить использование отпечатка пальца и лишить ваш браузер возможности доступа к платформе.

- Управление файлами cookie: Я пробовал использовать прокси-серверы и несколько профилей браузера, но постоянно сталкивался с проблемой перекрестного заражения файлов cookie. Поскольку все профили сохраняют файлы cookie моих сеансов входа в систему, платформы могли определить, что у меня есть другие учетные записи, вошедшие в систему с того же устройства, и что я занимаюсь веб-скреппингом.

Построение масштабируемой стратегии веб-скрепинга

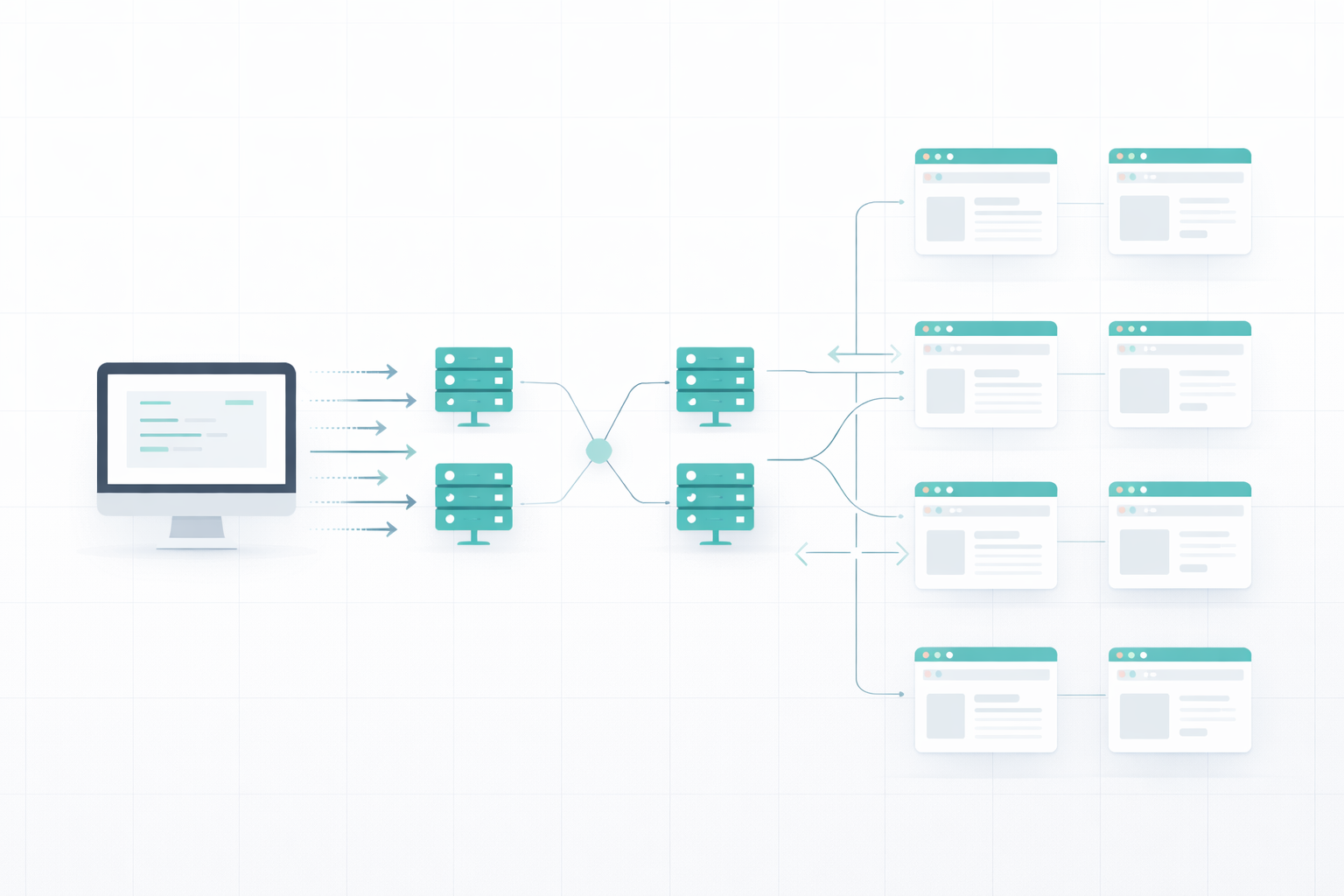

Существует несколько отличных сервисов для веб-скрейпинга, которые помогут вам построить масштабируемую систему веб-скрейпинга, не беспокоясь обо всех вышеописанных проблемах. Эти инструменты используют пул прокси-серверов и рандомизированные отпечатки браузеров, запускают все сессии скраппинга в облаке, чтобы не нагружать ваш компьютер, автоматически решают CAPTCHA, изолируют cookies и обрабатывают рендеринг Javascript.

Такие сервисы веб-скреппинга, как Floppydata, решают проблему масштабируемости за счет:

- Выполнение параллельных сессий браузера в облаке

- Используя вращающиеся IP-адреса из своего пула, состоящего из 90 миллионов прокси-серверов.

- Автоматическая обработка CAPTCHA и рендеринг JS

- Масштабирование по требованию без необходимости создания дополнительной инфраструктуры

Как автоматизировать веб-скраппинг?

Когда у вас есть масштабируемая инфраструктура, вам необходимо создать автоматизированную систему для управления прокси, извлечениями, ссылками, форматированием данных и т. д. Даже если скраппинг-сервисы предоставят вам масштабируемую инфраструктуру для обработки тысяч запросов в час, вы не сможете делать это вручную. Именно здесь на помощь приходят автоматизированные скрипты для скрапинга.

Некоторые сервисы веб-скреппинга предлагают шаблоны для известных платформ, таких как Reddit, Meta, Instagram, X. и др. Вы можете выбрать шаблон, настроить его в соответствии с вашим сценарием использования и начать скраппинг.

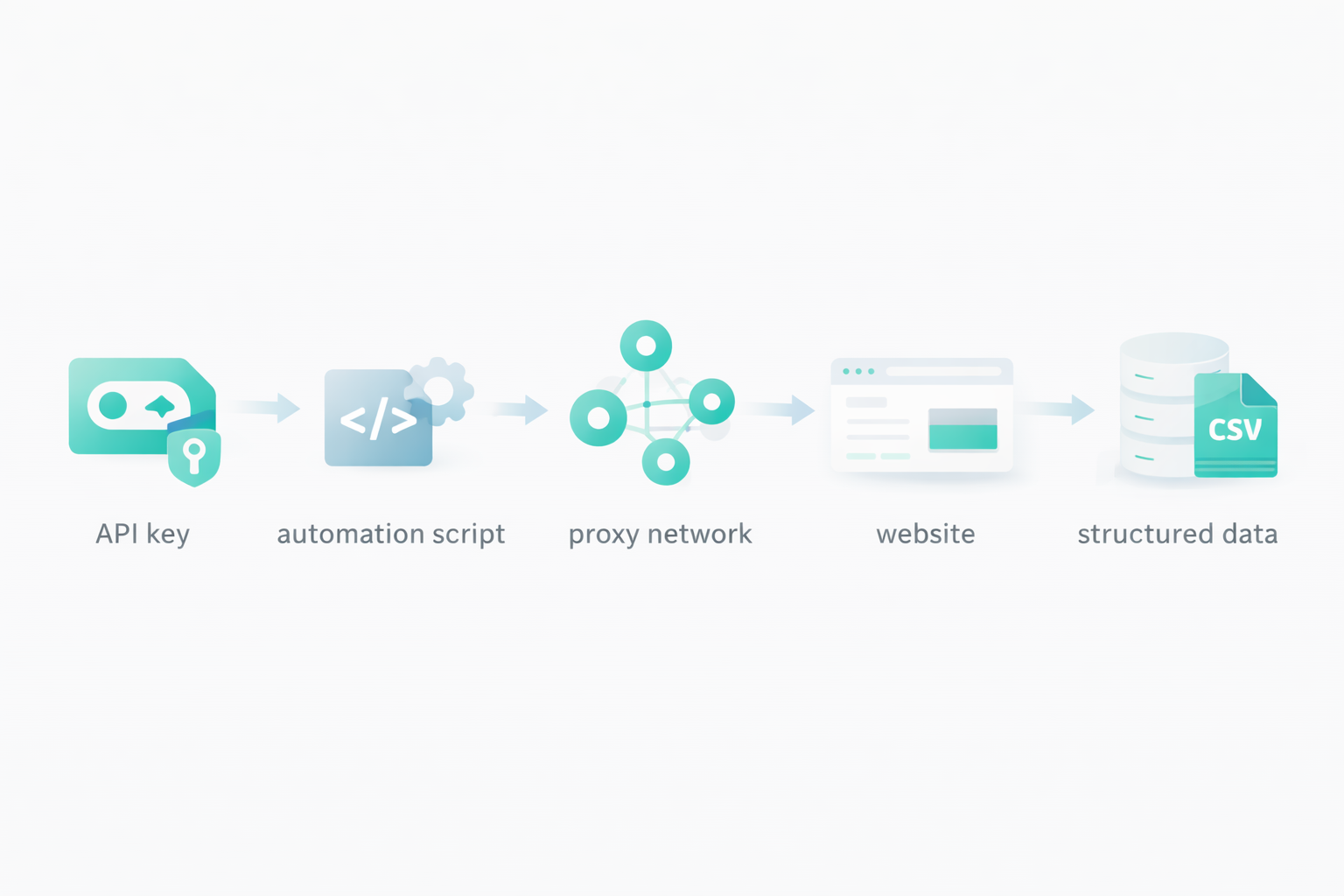

Еще один метод автоматизации веб-скреппинга, более популярный, — это API-ключи. Такие сервисы веб-скрепинга, как Floppydata, предлагают свои API-ключи, с помощью которых вы отправляете запросы на веб-скрепинг на их облачный сервер, а взамен получаете извлеченный контент. Когда вы используете API, возможности безграничны. Вы сами определяете формат извлечения данных, правила ротации прокси, какие страницы извлекать, какие поля извлекать, как их хранить, сколько задержек добавлять между каждым запросом, сколько одновременных запросов отправлять и многое другое.

Вы можете использовать этот API-ключ для создания инструментов скраппинга или интегрировать его в существующую систему компании. Все, что вам нужно, — это ключ API, а такие сервисы, как Floppydata, позаботятся обо всем остальном и предоставят вам конечные результаты.

Пошаговое руководство по масштабированию и автоматизации веб-скрапинга

Здесь представлено пошаговое руководство по созданию автоматизации веб-скреппинга с помощью Floppydata API.

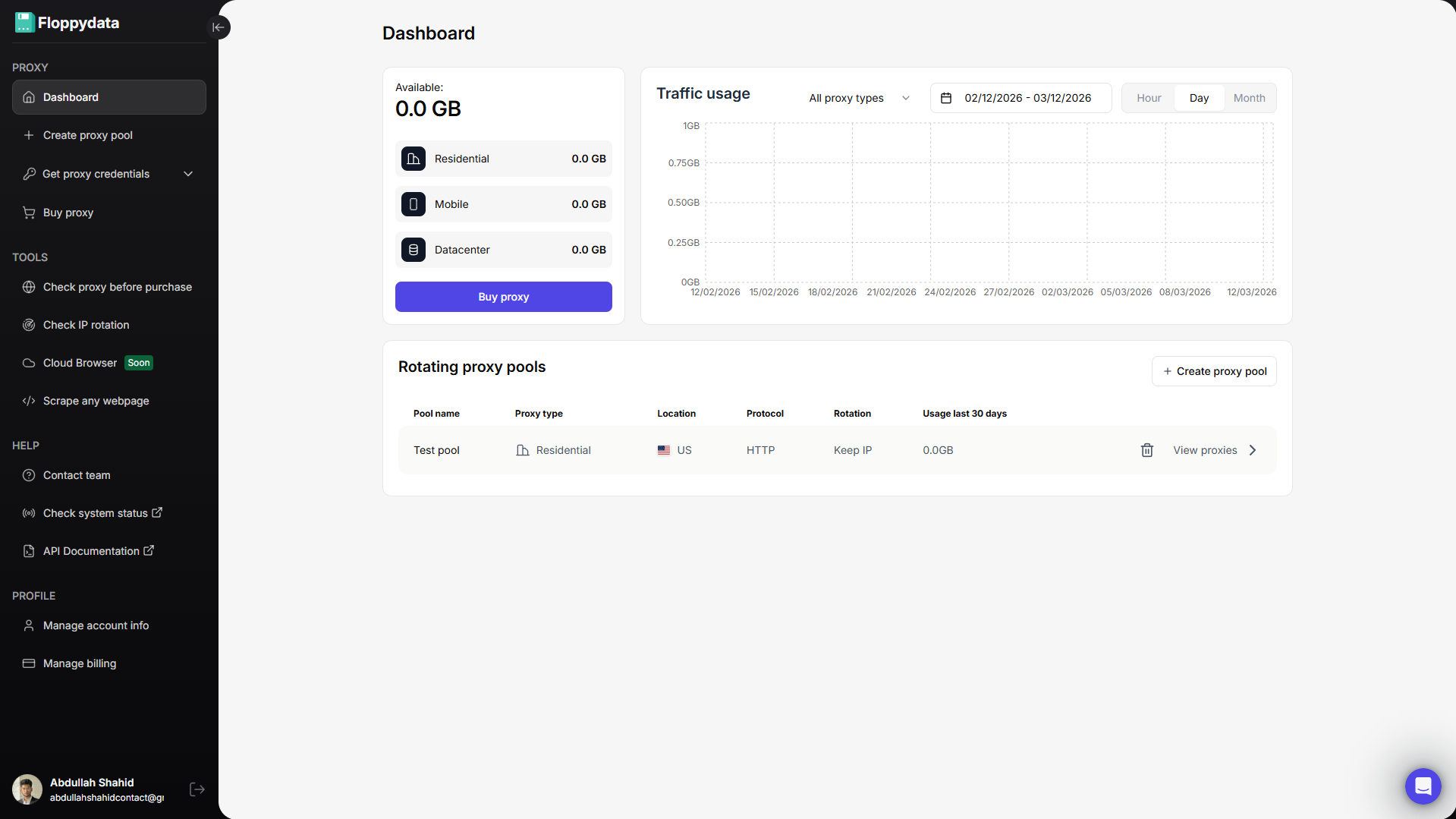

Шаг № 1: Создайте учетную запись Floppydata

Зарегистрируйтесь на Floppydata и откройте панель управления. Здесь вы можете управлять своими прокси-серверами и инструментами, такими как веб-разблокировщик.

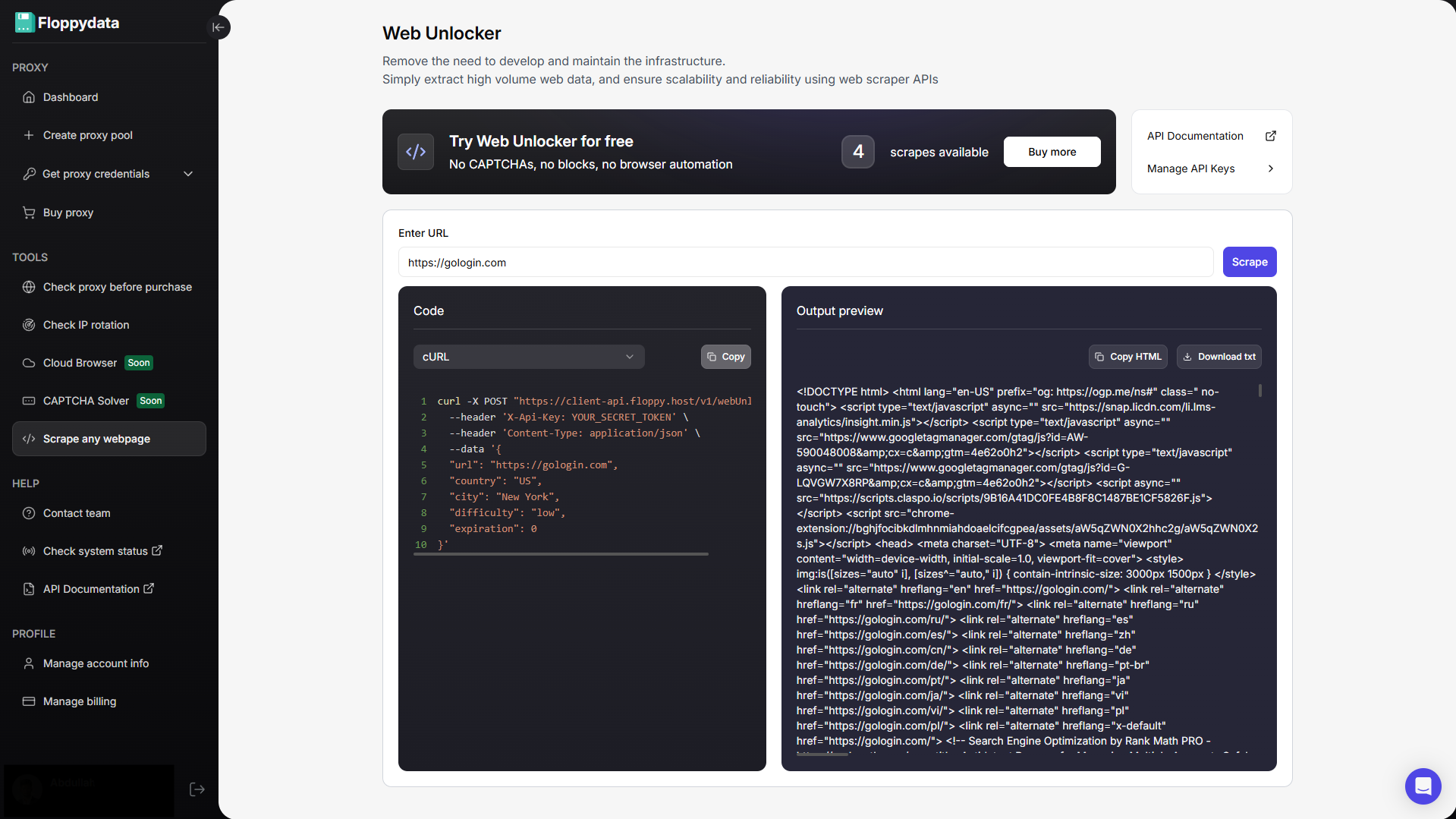

Шаг № 2: Анализ целевого URL-адреса

Вставьте URL-адрес в показанное поле и нажмите кнопку scrape. Вы получите HTML-содержимое этой страницы вместе со сниппетом кода для добавления в автоматизацию браузера. Если вы создаете автоматизацию для получения цен на товары с веб-сайта, вы можете использовать эту функцию анализа, чтобы определить, в каком HTML-теге содержится цена. Затем вы можете написать сценарий автоматизации, чтобы извлечь следующие теги и сохранить их в excel/csv-файле.

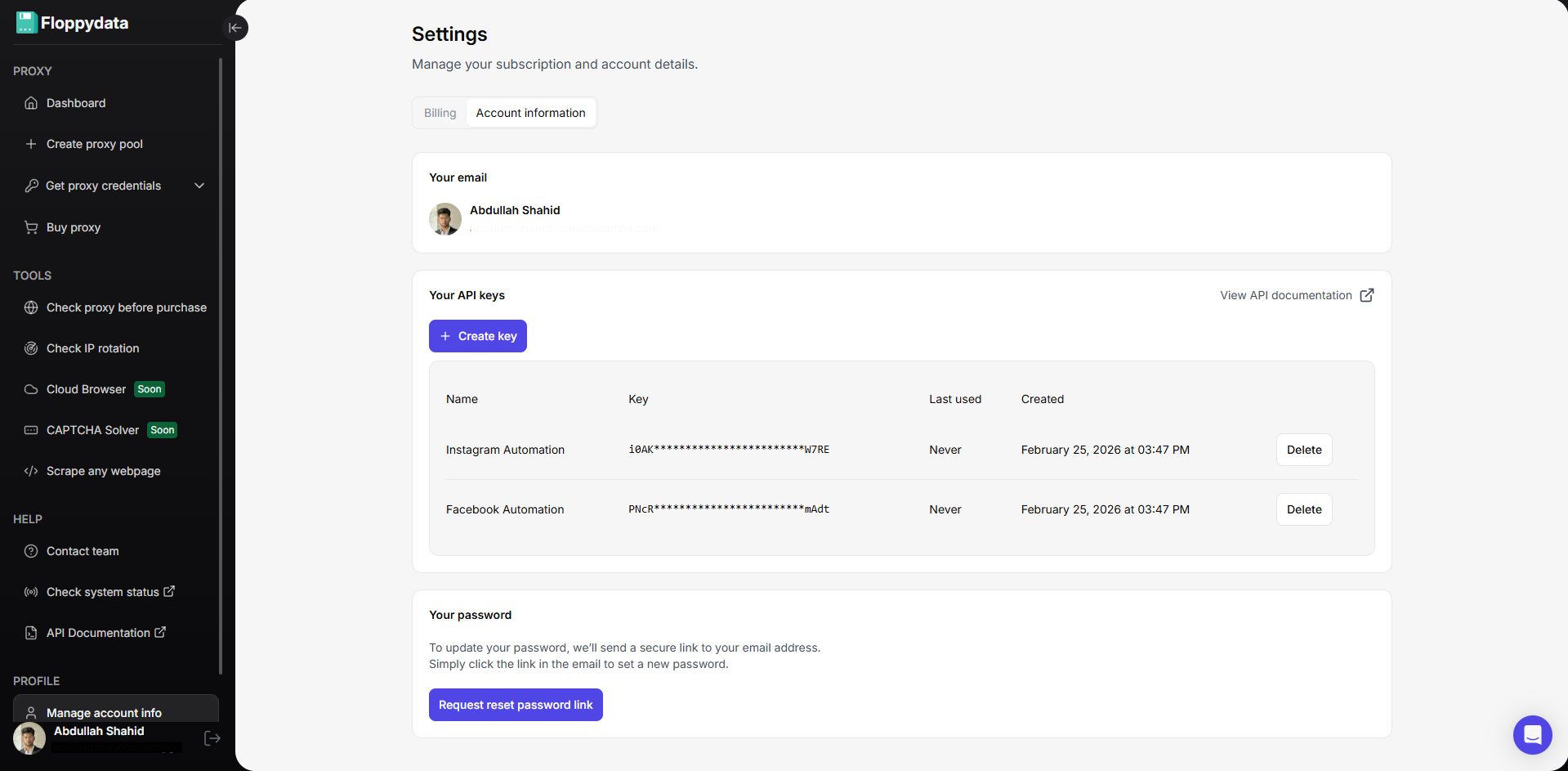

Шаг № 3: Создание ключей API для автоматизации

Вы можете создать API-ключи в настройках вашей учетной записи. Эти API-ключи будут использоваться в вашем скрипте автоматизации браузера для ротации прокси, разблокировки веб-сайтов и соскабливания данных. Floppydata Web Unlocker соскребает данные и отправляет их вашему скрипту через этот API.

Шаг #4: Напишите и запустите автоматизацию веб-скрепинга

Теперь, когда у вас есть API-ключ и прокси, вы можете создать сценарий веб-скрептинга на Python, Javascript, C# или GO. Поместите свой API-ключ в фрагмент кода, показанный на странице веб-разблокировщика, вместе с URL-адресами. Вот пример скрипта на Python, который я могу запустить в интерпретаторе Python для извлечения данных с дискуссионного форума Reddit:

httpx.post(

«https://client-api.floppy.host/v1/webUnlocker»,

headers={

«Content-Type»: «application/json»,

«X-Api-Key»: «YOUR_SECRET_TOKEN»

},

json={

«url»:

«https://www.reddit.com/r/automation/comments/1ntu327/top_5_antidetect_browsers_comparison_2025/»,

«country»: «US»,

«city»: «Нью-Йорк»,

«сложность»: «low»,

«expiration»: 0

}

)

Вы можете изменить страну, город и URL, чтобы изменить прокси и целевые ссылки. Это всего лишь фиктивный фрагмент кода. С помощью Claude Code или ChatGPT можно создавать сложные автоматические системы, которые будут динамически исследовать весь список целевых URL и извлекать полезный контент в выбранном вами формате.

Лучшие практики и советы по автоматизации веб-скрапинга

При создании автоматизированных рабочих процессов веб-скреппинга важно отдавать предпочтение не скорости, а отказоустойчивости и производительности. Ваш рабочий процесс должен обладать хорошей точностью. Если 40 % ваших запросов на поиск не будут выполнены, вы потеряете 40 % своего бюджета и не получите никаких результатов. Хотя Floppydata взимает плату только за успешное извлечение страниц, другие сервисы взимают плату за 1 тыс. запросов, даже если все они провалены.

Чтобы создать автоматизацию, которая станет частью вашего рабочего процесса на несколько недель или месяцев, необходимо обеспечить несколько ключевых моментов:

- Ротация IP-адресов для каждого работника или сессии

- Масштабируйте скрапбукинг с помощью параллельных сессий, а не за счет увеличения скорости или сокращения времени ожидания.

- Используйте веб-разблокировщики для сайтов с большим количеством блоков

- Предпочитайте API, если они доступны

- Изолируйте отпечатки пальцев браузера

- Записывайте ошибки в журнал и грамотно повторяйте попытки

- Проведите небольшое тестирование, прежде чем масштабировать большие масштабы

- Покупайте чистые прокси-серверы у надежного поставщика

Вам не нужно беспокоиться о прокси, если вы используете инструмент для разблокировки веб-сайтов от прокси-провайдеров, таких как Floppydata, BrightData, Oxylabs и т. д., поскольку они могут включать чистые IP-адреса для своего инструмента.

Основные выводы

Масштабирование и автоматизация веб-скреппинга все еще возможны в 2026 году и могут быть очень эффективными, если вы все сделаете правильно. Если вы будете следовать стратегиям, о которых я рассказывал в этом блоге, и отдавать предпочтение устойчивости, а не скорости, вы сможете создать повторяющуюся автоматизацию, которая проработает несколько месяцев, прежде чем вам понадобится вносить какие-либо изменения. При наличии надлежащей инфраструктуры вам не нужно будет беспокоиться о какой-либо системе защиты от ботов.

Поделиться этой статьей:

Содержание

Прокси по цене $1

Получите неограниченные возможности