Запустити автоматизацію веб-скрепінгу у 2026 році буде непросто. Оскільки багато AI-компаній намагаються зішкребти якомога більше даних з інтернету для навчання моделей, такі платформи, як Reddit, Meta, X та інші, розгортають системи виявлення на основі штучного інтелекту, щоб заблокувати веб-скрепери від доступу до публічних даних користувачів. Отже, у цьому посібнику ми розглянемо, як масштабувати та автоматизувати веб-скрепінг у 2026 році.

Чому веб-скрепінг стає все складнішим?

Ось кілька причин, чому компанії активно виявляють і блокують автоматизовані системи веб-скрепінгу.

- Веб-скрепери створюють зайве навантаження на сервери, оскільки надсилають сотні або навіть тисячі одночасних автоматизованих запитів.

- Рекламодавці не люблять ботів, тому що реклама показується боту, який витягує дані зі сторінки, і витрати на рекламу йдуть даремно.

- Більшість компаній вважають за краще продавати свої дані іншим AI-компаніям або навчати власні моделі. Саме тому вони не хочуть, щоб скрепери витягували дані з їхньої платформи безкоштовно.

Тим не менш, у 2026 році все ще існуватимуть ефективні методи збору даних, які не тільки безпечні у використанні, але й масштабовані, легко автоматизуються та працюють для всіх веб-сайтів. Оскільки анти-боти стають розумнішими завдяки штучному інтелекту, веб-скрепери також наздоганяють їх, забезпечуючи автоматичне розгадування CAPTCHA, рандомізацію рухів і кліків миші, ротацію IP-адрес, рандомізацію відбитків пальців у браузері та багато іншого.

Як масштабувати веб-скрейпінг?

Зіскребти одну-дві веб-сторінки не проблема, але як ми можемо зіскребти тисячі веб-сторінок протягом декількох годин або днів? Ми не можемо відкрити таку кількість вкладок на своєму пристрої через обмеження оперативної пам’яті та швидкості обробки, і якщо наш IP буде заблоковано в перші ж хвилини, нам доведеться переключитися на інший пристрій.

Масштабування веб-скрейпінгу вимагає розуміння і планування. По-перше, давайте розберемося з викликами у веб-скрейпінгу.

Виклики у веб-скрепінгу та парсингу

Веб-сайти – це вже не просто статичні HTML-сторінки. Анти-боти постійно відстежують активність користувачів і якість трафіку, щоб забезпечити доступ до сайтів лише реальним користувачам, а скрапери миттєво блокуються. Ось з якими проблемами я зіткнувся, коли почав займатися веб-скрепінгом:

- Обмеження IP-адреси: Платформи відстежують кількість запитів на одну IP-адресу щохвилини та щогодини. Якщо IP-адреса намагається перевищити ліміт, обліковий запис призупиняється або тимчасово відключається за спам-активність.

- Рендеринг Javascript: Багато веб-сайтів зараз завантажують вміст динамічно. Коли скрейпер намагається отримати HTML-вміст, він отримує пропущені поля, оскільки деякі частини сторінки не були завантажені.

- CAPTCHA: Мої скрипти для веб-скрепінгу не могли розпізнати CAPTCHA і продовжували блокувати мене. Facebook навіть заблокував мій IP, і я не міг отримати доступ до нього через той самий IP знову.

- Виявлення поведінки: Веб-сайти відстежують вашу поведінку, наприклад, активність прокрутки, рухи миші, випадковість кліків тощо, щоб зрозуміти, чи є ви ботом, чи реальною людиною.

- Відстеження відбитків пальців: Платформи зберігають і відстежують відбитки пальців вашого браузера, щоб визначити, які пристрої використовують цей обліковий запис. Якщо буде виявлено порушення умов та послуг, вони можуть заборонити використання відбитків пальців і припинити доступ вашого браузера до платформи.

- Керування файлами cookie: Я намагався використовувати проксі-сервери та кілька профілів браузера, але постійно стикався з проблемами перехресного забруднення файлів cookie. Оскільки всі профілі зберігають файли cookie моїх сесій входу в систему, платформи могли визначити, що у мене є інші акаунти, які увійшли в систему з того ж пристрою, і я виконую веб-скрепінг.

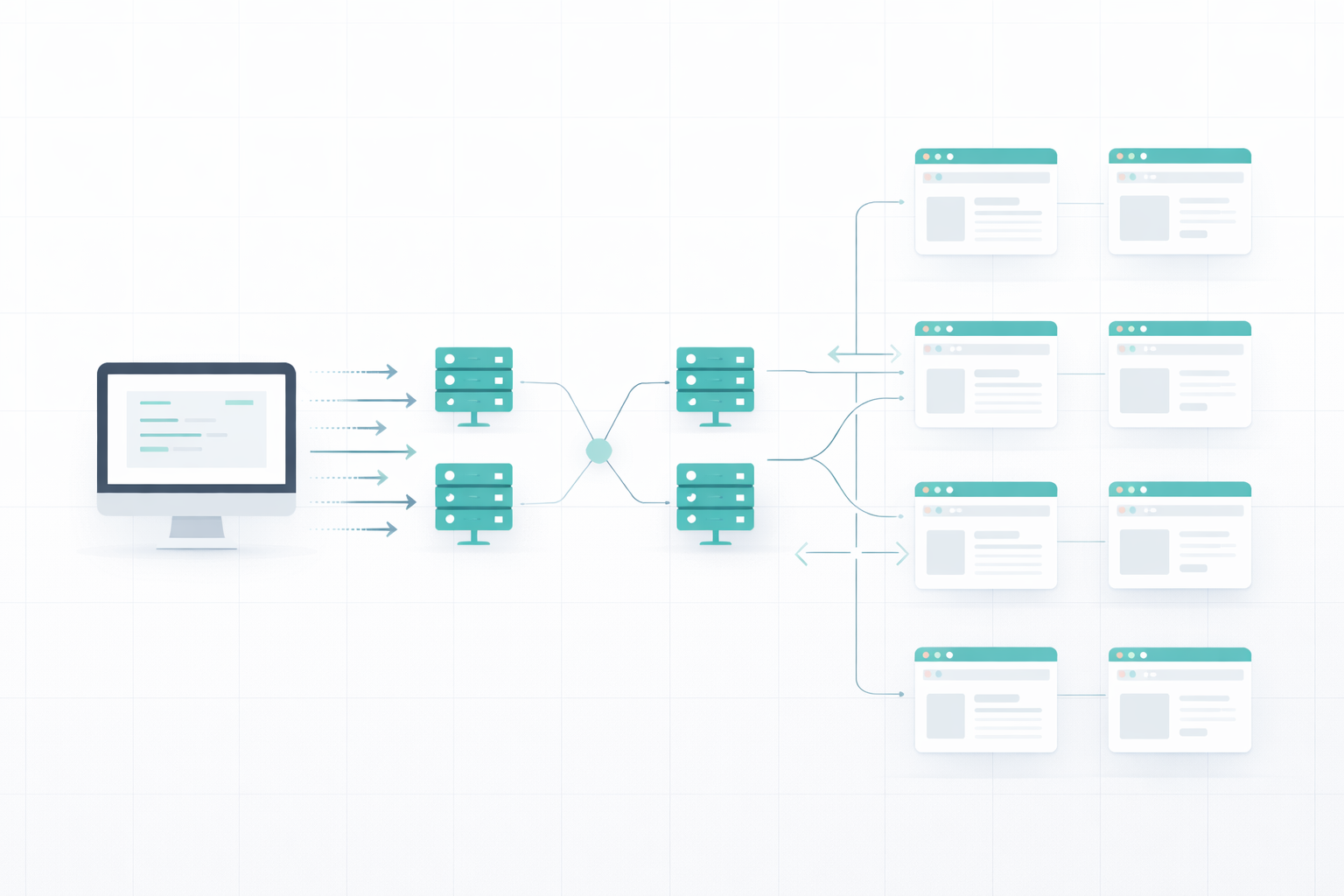

Побудова масштабованої стратегії веб-скрепінгу

Існує кілька чудових сервісів веб-скрепінгу, які допоможуть вам створити масштабовану систему веб-скрепінгу, не турбуючись про всі проблеми, описані вище. Ці інструменти веб-скрепінгу використовують пул проксі-серверів і рандомізованих відбитків браузера, запускають всі ваші сеанси скріпінгу в хмарі, щоб уникнути навантаження на ваш комп’ютер, автоматично вирішують CAPTCHA, ізолюють файли cookie і обробляють рендеринг Javascript.

Сервіси веб-скрепінгу, такі як Floppydata, вирішують проблему масштабованості за рахунок:

- Запуск паралельних сесій браузера в хмарі

- Використання ротаційних IP з пулу з 90 мільйонів проксі-серверів

- Автоматична обробка CAPTCHA та рендеринг JS

- Масштабування на вимогу без необхідності створення додаткової інфраструктури

Як автоматизувати веб-скрепінг?

Коли у вас є масштабована інфраструктура, вам потрібно створити автоматизовану систему для управління проксі-серверами, витягами, посиланнями, форматуванням даних тощо. Навіть якщо сервіси скрапінгу надають вам масштабовану інфраструктуру для обробки тисяч запитів на годину, ви не можете робити це вручну. Саме тут на допомогу приходять скрипти для автоматизації скрапінгу.

Деякі сервіси веб-скрепінгу пропонують попередньо налаштовані шаблони для відомих платформ, таких як Reddit, Meta, Instagram, X тощо. Ви можете вибрати шаблон, налаштувати його відповідно до вашого сценарію використання і почати скрапінг.

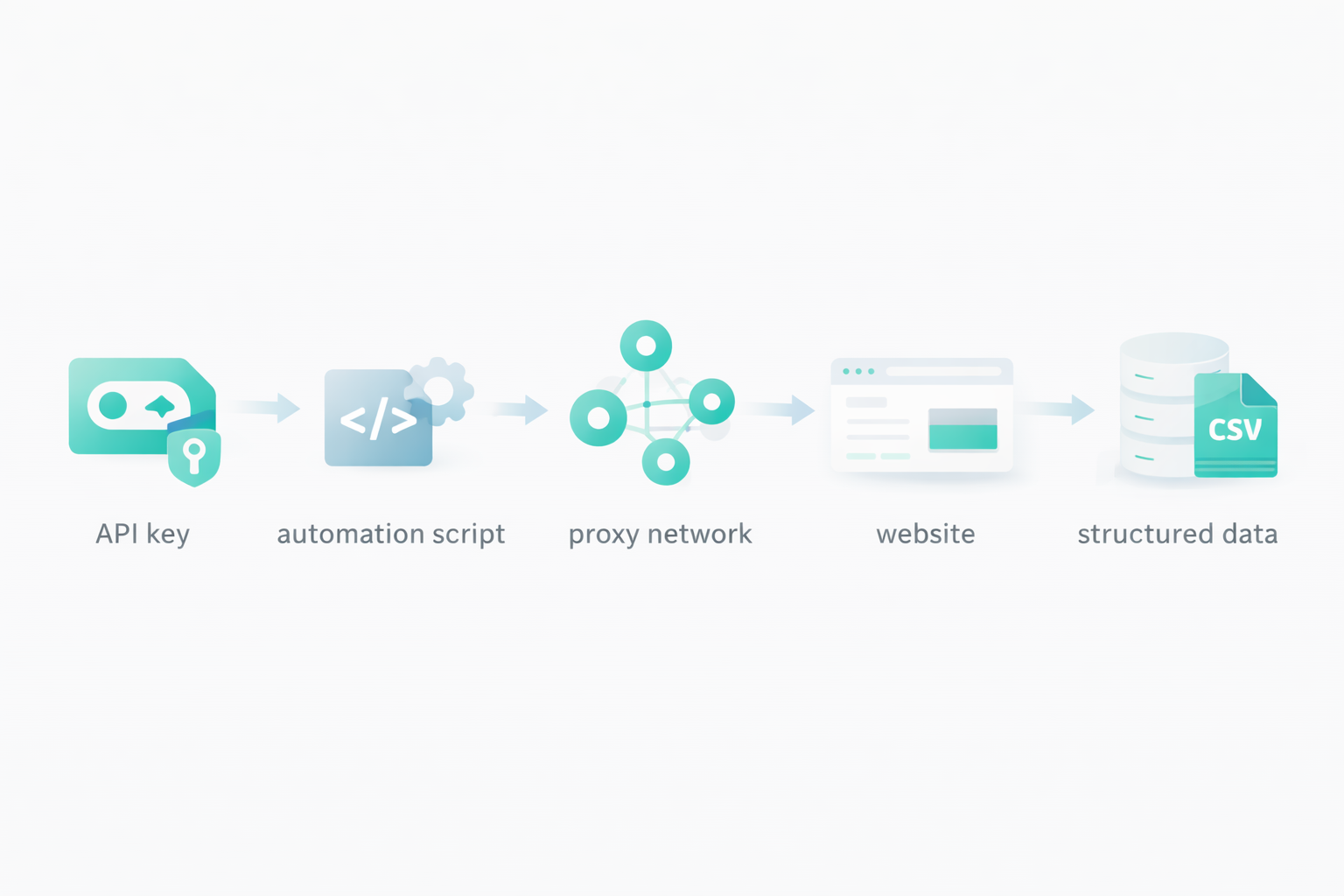

Ще один метод автоматизації веб-скрепінгу, який є більш популярним, – це API-ключі. Сервіси веб-скрепінгу, такі як Floppydata, пропонують свої API-ключі, за допомогою яких ви можете надсилати запити на веб-скрепінг на їхній хмарний сервер і отримувати витягнутий вміст у відповідь. Коли ви використовуєте API, можливості безмежні. Ви визначаєте власний формат вилучення даних, правила ротації проксі, які сторінки витягувати, які поля витягувати, як їх зберігати, скільки затримки додавати між кожним запитом, скільки одночасних запитів надсилати і багато іншого.

Ви можете використовувати цей API-ключ для створення інструментів вилучення або інтегрувати його в існуючу систему вашої компанії. Все, що вам потрібно – це ключ API, а такі сервіси, як Floppydata, подбають про все інше і нададуть вам остаточні результати.

Покрокове керівництво з масштабування та автоматизованого веб-скребкування

Ось покрокове керівництво по створенню автоматизації веб-скрепінгу за допомогою Floppydata API.

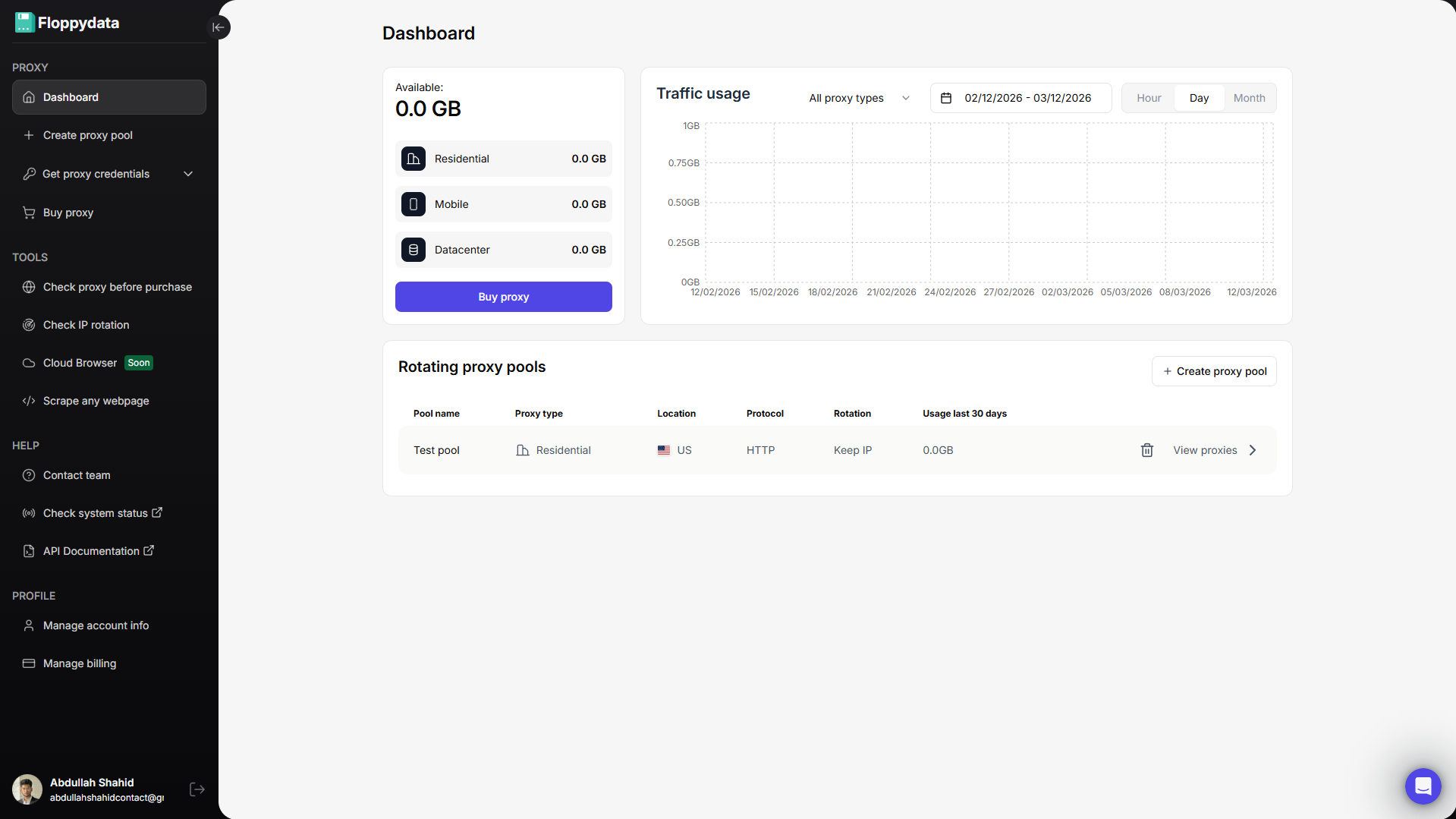

Крок 1: Створіть обліковий запис Floppydata

Зареєструйтеся на Floppydata і відкрийте інформаційну панель. Тут ви можете керувати своїми проксі-серверами та інструментами, такими як веб-розблокувальник.

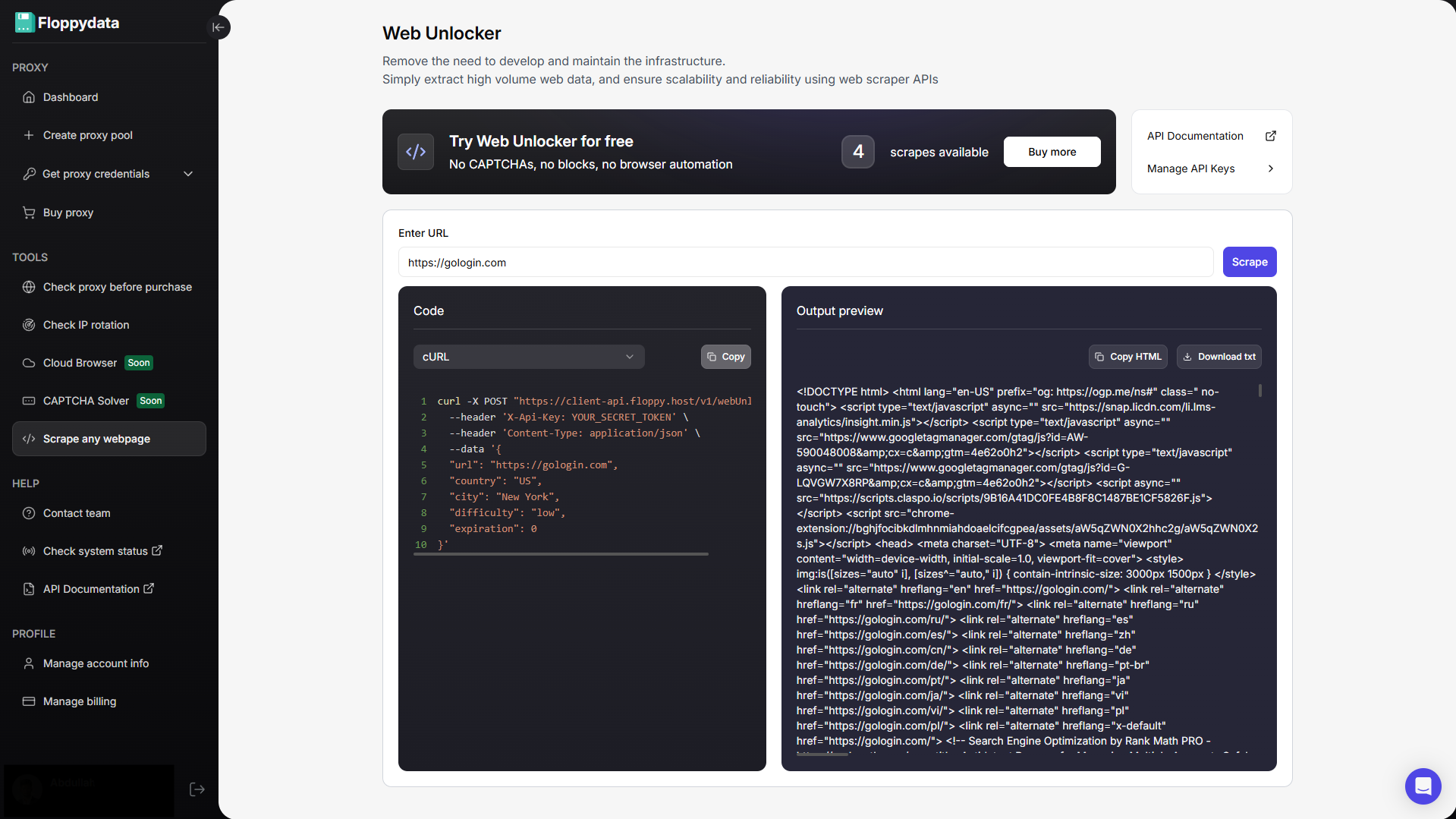

Крок #2: Проаналізуйте цільову URL-адресу

Вставте вашу URL-адресу в показане поле і натисніть кнопку “Витягти”. Ви отримаєте HTML-вміст цієї сторінки разом із фрагментом коду, який можна додати до автоматизації вашого браузера. Якщо ви створюєте автоматизацію для отримання цін на продукти з веб-сайту, ви можете використовувати цю функцію аналізу, щоб визначити, який HTML-тег містить ціну. Потім ви можете написати сценарій автоматизації, щоб витягти ці теги і зберегти їх у файлі excel/csv.

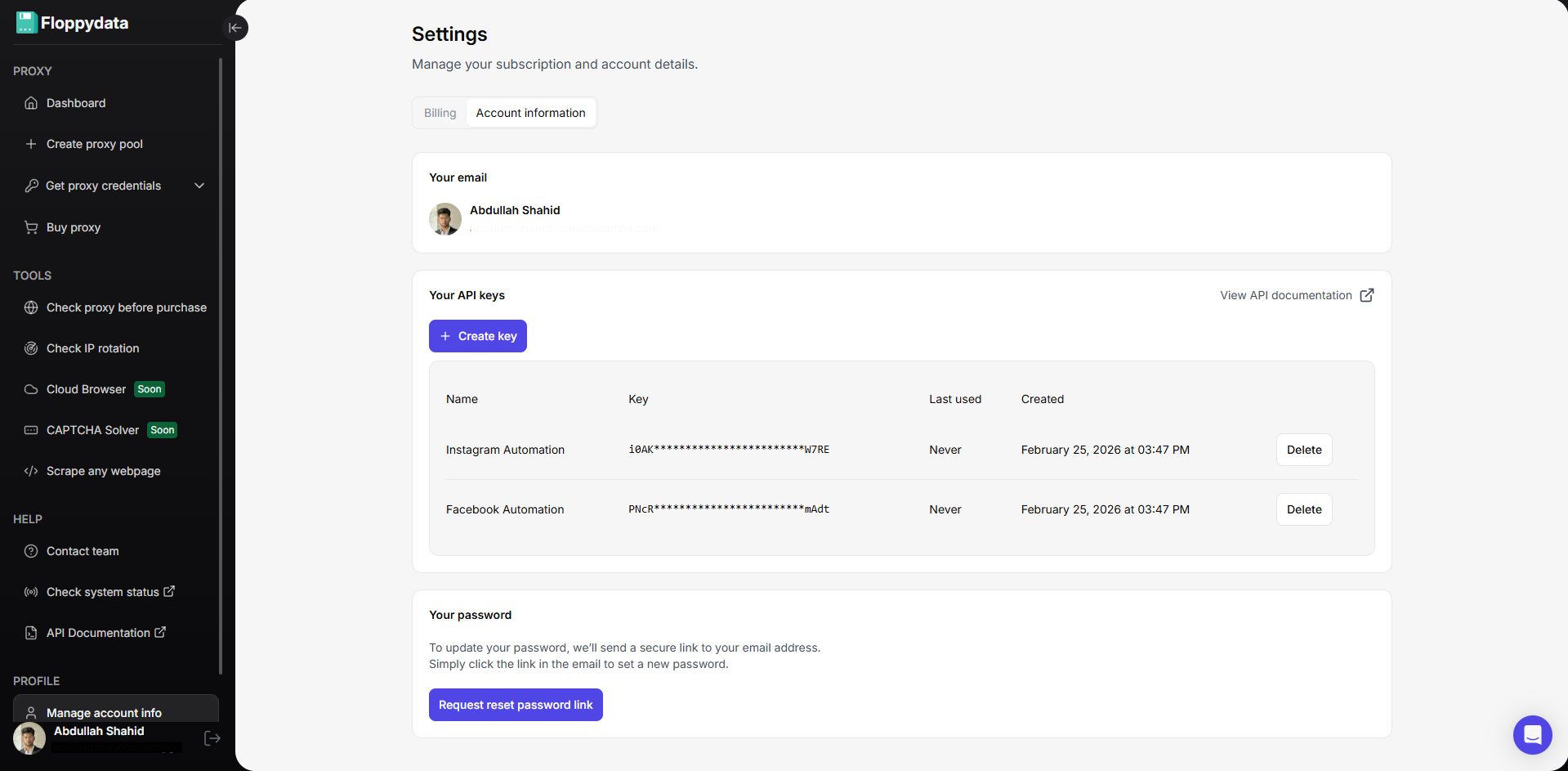

Крок #3: Створіть ключі API для автоматизації

Ви можете створити ключі API в налаштуваннях свого облікового запису. Ці ключі API будуть використовуватися у вашому скрипті автоматизації браузера для ротації проксі-серверів, розблокування веб-сайтів і вилучення даних. Floppydata Web Unlocker збирає дані і надсилає їх вашому скрипту через цей API.

Крок #4: Напишіть і запустіть автоматизацію веб-скрепінгу

Тепер, коли у вас є ключ API і проксі, ви можете створити скрипт веб-скрепінгу на Python, Javascript, C# або GO. Помістіть ваш ключ API у фрагмент коду, показаний на сторінці веб-розблокувальника, разом з URL-адресами. Ось короткий приклад скрипта на Python, який я можу запустити в інтерпретаторі Python, щоб витягти дані з дискусійного форуму Reddit:

httpx.post(

“https://client-api.floppy.host/v1/webUnlocker”,

headers={

“Content-Type”: “application/json”,

“X-Api-Key”: “YOUR_SECRET_TOKEN”

},

json={

“url”:

“https://www.reddit.com/r/automation/comments/1ntu327/top_5_antidetect_browsers_comparison_2025/”,

“country”: “US”,

“city”: “New York”,

“difficulty”: “low”,

“expiration”: 0

}

)

Ви можете змінити країну, місто і URL-адресу, щоб змінити проксі і цільові посилання. Це лише фіктивний фрагмент коду. Ви можете створювати складні автоматизовані системи за допомогою Claude Code або ChatGPT, які будуть динамічно досліджувати весь список цільових URL-адрес і витягувати корисний вміст у вибраному вами форматі.

Найкращі практики та поради щодо автоматизації веб-скрепінгу

Створюючи автоматизовані робочі процеси зіскрібання веб-сторінок, важливо надавати перевагу стійкості та продуктивності, а не швидкості. Ваш робочий процес повинен мати хорошу точність. Якщо 40% ваших запитів на вилучення не будуть виконані, ви втратите 40% свого бюджету, не отримавши жодних результатів. Хоча Floppydata стягує плату лише за успішне вилучення сторінок, інші сервіси беруть плату за 1 тис. запитів, навіть якщо всі вони виявилися невдалими.

Щоб створити автоматизацію, яка стане частиною вашого робочого процесу на тижні або місяці, вам потрібно забезпечити кілька ключових речей:

- Ротація IP-адрес для кожного працівника або сеансу

- Вишкрібання накипу за допомогою паралельних сеансів, а не за рахунок збільшення швидкості або скорочення часу очікування

- Використовуйте Web Unlocker для сайтів з високим рівнем блокування

- Надавати перевагу API, якщо вони доступні

- Ізолюйте відбитки пальців у браузері

- Фіксуйте помилки та розумно повторюйте спроби

- Тестуйте мале, перш ніж масштабувати велике

- Купуйте чисті проксі у перевіреного постачальника

Вам не потрібно турбуватися про проксі, якщо ви використовуєте інструмент для розблокування веб-сторінок від проксі-провайдерів, таких як Floppydata, BrightData, Oxylabs тощо, оскільки вони можуть включати чисті IP-адреси для своїх інструментів.

Основні висновки

Масштабування та автоматизація веб-скрепінгу все ще можлива у 2026 році і може бути дуже ефективною, якщо все робити правильно. Якщо ви будете дотримуватися стратегій, які я описав у цьому блозі, і надасте перевагу відмовостійкості, а не швидкості, ви зможете створити повторювану автоматизацію, яка працюватиме місяцями, перш ніж вам знадобиться вносити будь-які зміни. Маючи належну інфраструктуру, вам не потрібно турбуватися про будь-яку анти-бот-систему.

Поділіться цією статтею:

Зміст

Проксі за $1

Отримайте необмежені можливості